Last Channel

Last Channel 理论上是一种高效的存储格式,可以加速存取和运算效果

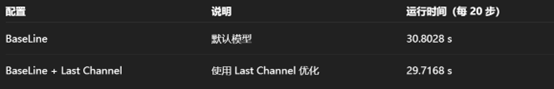

官方文档中给出 22% 左右的效率提升,但本人的简单神经网络上并没有看到显著的区别

总体应当属于有益无害的类型,图像处理领域可以作为一种标准遵守

补注:

1.Last Channel 的代码实现上并不简单,若真正要使用,需要考虑工程量和提升幅度的性价比

1.本人实验内,采用小型数据集和小型网络进行实现,而实际上其实验结果值得推敲:

该标准是否在大型模型、大型数据集或者其他场景上更能凸显优势?

实现方案是否存在漏洞,导致没有完全实现 Last Channel?

上述实验应当是需要做的,为彻底清楚该组件的效果和具体的影响因素

2.此外,理解其原理和效率提升的来源也是必要的

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 Ephemeral!